人工智能学习PyTorch实现CNN卷积层及nn.Module类示例分析

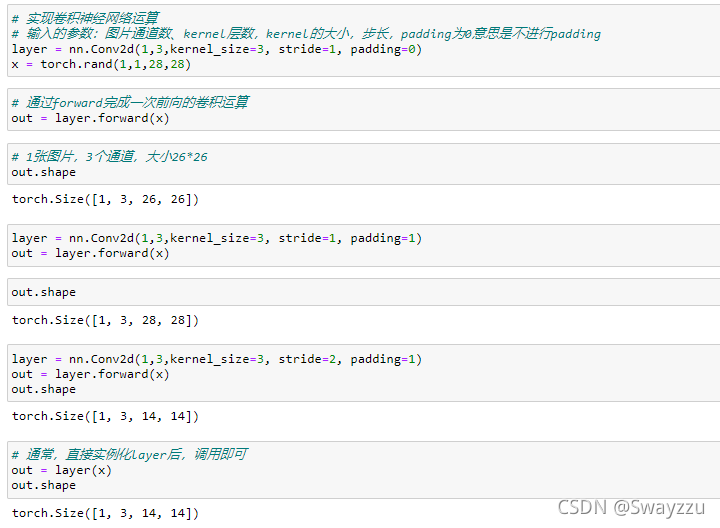

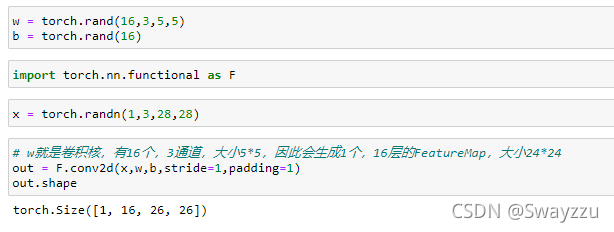

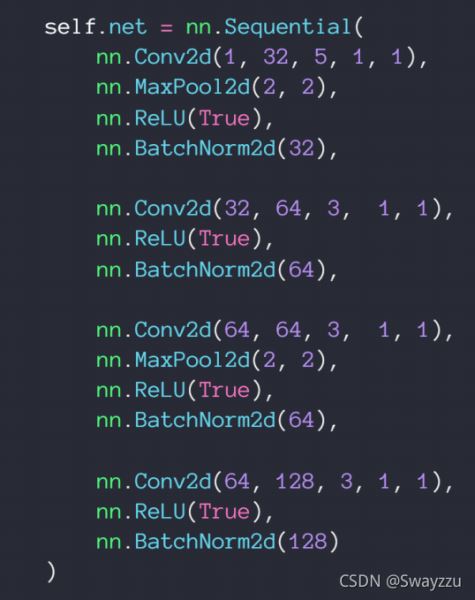

1.CNN卷积层

通过nn.Conv2d可以设置卷积层,当然也有1d和3d。

卷积层设置完毕,将设置好的输入数据,传给layer(),即可完成一次前向运算。也可以传给layer.forward,但不推荐。

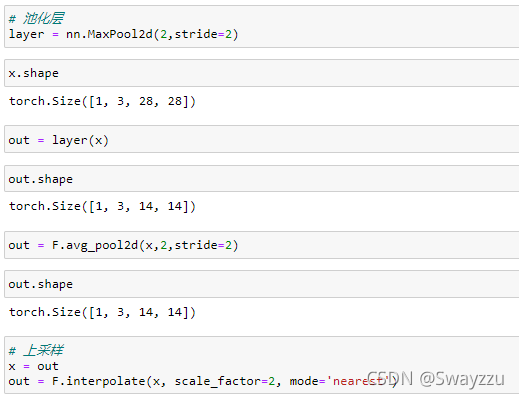

2. 池化层

池化层的核大小一般是2*2,有2种方式:

maxpooling:选择数据中最大值输出

avgpooling:计算数据的均值并输出

通过这一层可以实现降采样。

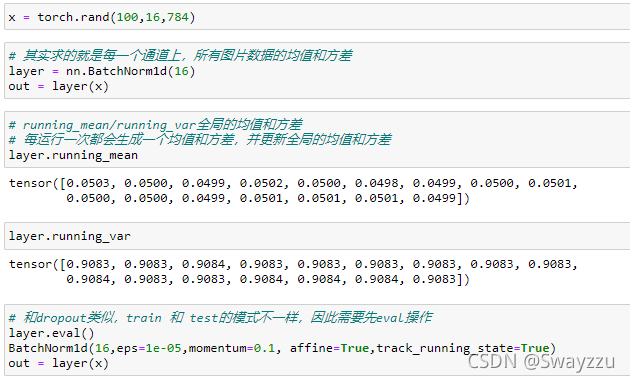

3.数据批量标准化

Batch Normalize,在计算过程中,通常输入的数据都是0-255的像素数据,不方便计算,因此可以通过nn.BatchNorm1d方法进行标准化。

标准化后,可以通过running_mean, running_var获取全局的均值和方差。

4.nn.Module类

①各类函数

Linear, ReLU, Sigmoid, Conv2d, Dropout等等

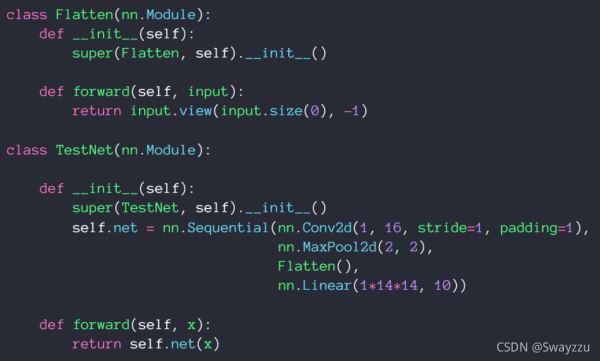

②容器功能

我们可以直接在定义自己的层的时候,把所有我们需要用到的层及相关函数放进去。使用的时候直接调用即可。

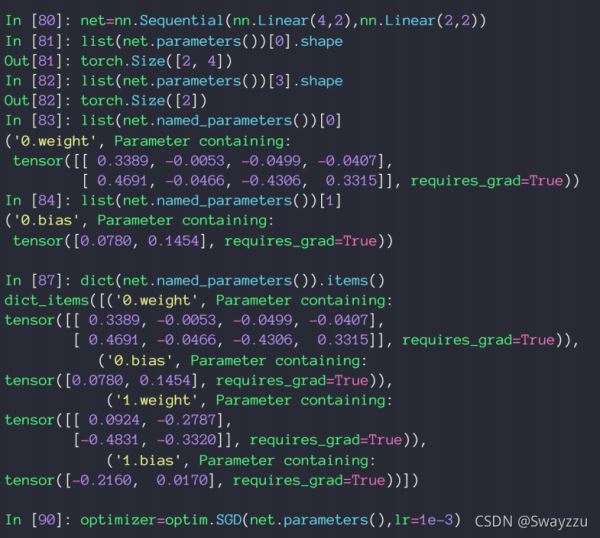

③参数管理

在这个类中可以直接生成我们需要的参数,并且自动带上梯度的需求。

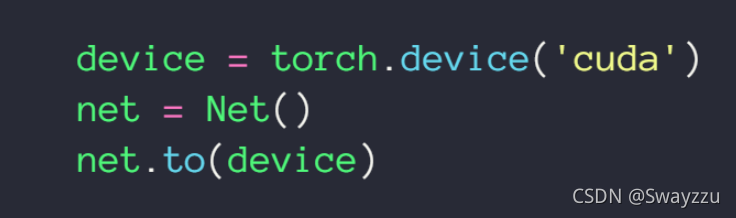

④调用GPU

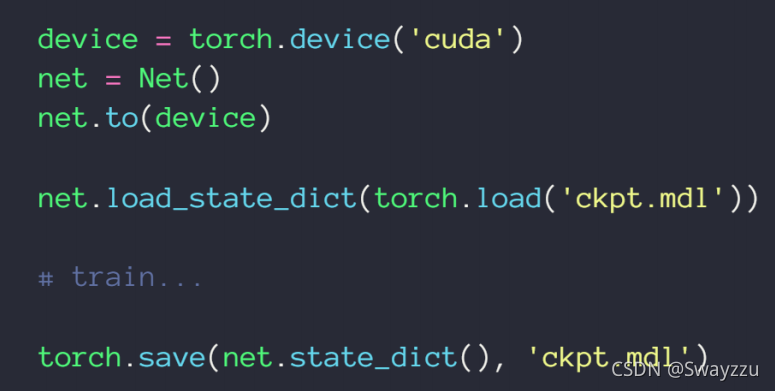

⑤存储和加载

训练过程中可以根据需求,比如训练到某一个点的时候达到了最优,可以将其存储。

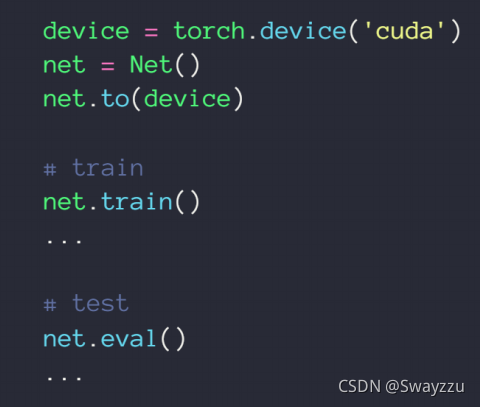

⑥训练、测试状态切换

直接调用根节点的train, eval就可以切换。

⑦ 创建自己的层

还有其他功能,但现在还不理解,因此先不往上写了。

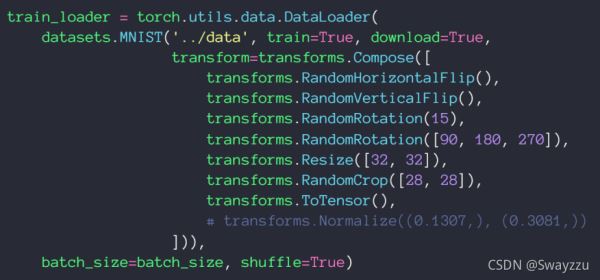

5.数据增强

数据增强主要用在我们数据不够用的时候,对原来的数据进行调整,从而生成新的数据。比如一张图片,我们可以对其进行翻转、旋转、大小调整、切割等操作 。导入数据的时候即可进行,具体实现方式如下。

以上就是人工智能学习PyTorch实现CNN卷积层及nn.Module类示例分析的详细内容,更多关于PyTorch中CNN及nn.Module的资料请关注本站其它相关文章!

版权声明:本站文章来源标注为YINGSOO的内容版权均为本站所有,欢迎引用、转载,请保持原文完整并注明来源及原文链接。禁止复制或仿造本网站,禁止在非www.yingsoo.com所属的服务器上建立镜像,否则将依法追究法律责任。本站部分内容来源于网友推荐、互联网收集整理而来,仅供学习参考,不代表本站立场,如有内容涉嫌侵权,请联系alex-e#qq.com处理。

关注官方微信

关注官方微信